NLP(九十)OpenAI的Chat_Completion_API中的logprobs参数

OpenAI的Chat Completion

API中引入了logprobs参数。当logprobs参数被启用时,API会返回每个输出token的log概率,同时返回每个token位置最可能的几个token和它们的log概率。与之相关的两个参数:

- logprobs:是否返回每个输出token的log概率

- top_logprobs:整数,每个token位置最可能的token个数以及它们的log概率。若需使用该参数,则

logprobs参数需设置为true.

在OpenAI的官方CookBook网站中,该网站给出了logprobs参数的介绍及可能的应用。

本文在此基础上,再给出一种可能的应用场景:双栏论文中的上下文连接。

双栏论文上下文连接

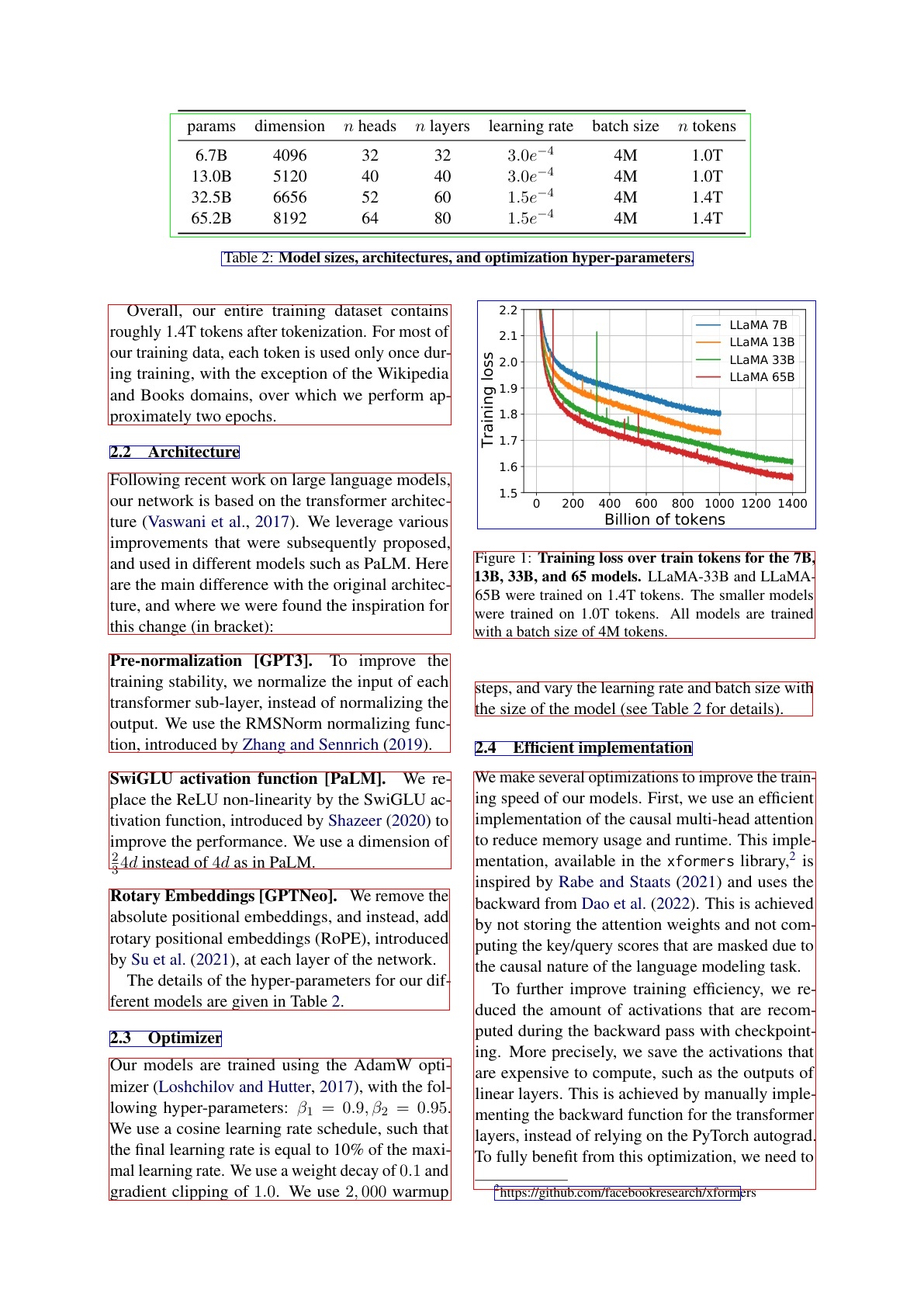

以LLAMA论文中的第三页为例,其版面分析的结果如下:

此时,我们想要知道左侧Optimizer下方的文本区域中的warmup之后的文字应该与哪个右侧的文本区域连接。

我们考虑使用OpenAI的Chat Completion API的logprobs参数,去观察warmup后的下一个token位置上最可能的几个token。

示例Python代码如下:

1 | |

输出结果如下:

1 | |

由此可见,右侧栏的以steps开头的文本区域应当与warmup结尾的文本区域相连接。

参考文献

- Using logprobs: https://cookbook.openai.com/examples/using_logprobs

欢迎关注我的公众号NLP奇幻之旅,原创技术文章第一时间推送。

欢迎关注我的知识星球“自然语言处理奇幻之旅”,笔者正在努力构建自己的技术社区。

NLP(九十)OpenAI的Chat_Completion_API中的logprobs参数

https://percent4.github.io/NLP(九十)OpenAI的Chat-Completion-API中的logprobs参数/